Con el pasar del tiempo, es fácil darse cuenta de la manera en la cual los sistemas se van haciendo cada vez más autónomos gracias a la ayuda de la Inteligencia Artificial.

Tal como quedo claro en el Huawei Connect 2019, los sistemas han evolucionado gracias a la Computación Inteligente a tal punto que, pueden aprender sobre un determinado proceso de forma adaptativa, por medio de la observación y el censo de las estadísticas. Todo con el fin de encontrar la solución apropiada para procesar escenarios. Teniendo en cuenta que en ocasiones, no tienen normas bien definidas y, que muchas veces, son la base de entrenamiento para la Inteligencia Artificial.

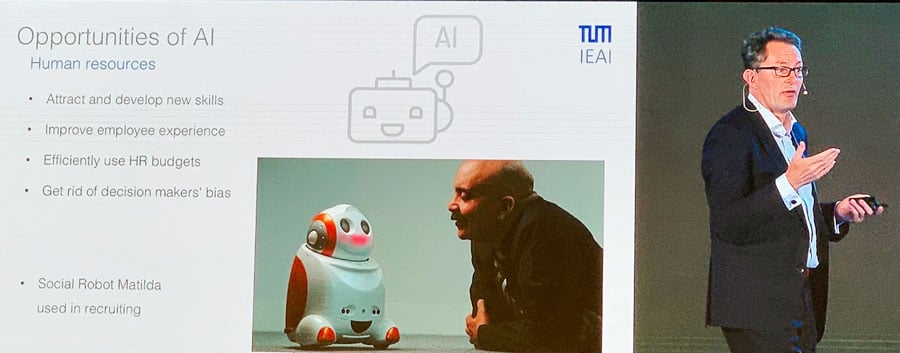

Cada vez más, la relación entre el usuario, el dispositivo y la nube es más estrecha gracias al uso de la Inteligencia Artificial. Lo que ha hecho que pase de ser un “Hype” a un componente tangible en los negocios. Más allá de reemplazar al humano, pretende complementarlo para abrir nuevas posibilidades en la industria, por medio de más potencia computacional, eficiencia energética, más velocidad y la optimización en el uso de los recursos disponibles.

Si todo se ve tan bien ¿qué problemas pueden traer consigo el uso de la Inteligencia Artificial?

Tal como era de esperarse, en etapas tempranas del desarrollo del entrenamiento y depuración de los sistemas con Inteligencia Artificial. Existe un componente supremamente importante que, muchas veces los científicos tienden a dejar de lado u olvidar. Se trata de la ética a nivel de la integración de AI, dado que los sistemas tienen a aprender por medio de la observación para generar su propia interpretación del mundo que los rodea. De esta forma, generar algún tipo de reacción “estimulo-respuesta”.

Es importante empezar a considerar la ética a nivel de las máquinas que, al final del día, tienden a ser simplemente sistemas sin moralidad alguna que, en algún momento, deben llegar a tomar decisiones.

¿Qué ejemplo nos puede servir para mostrar este concepto?

Para ilustrar mejor el concepto, vale la pena hablar de los carro autónomos. En un futuro muy cercano, tienden a deambular por las ciudades sin un conductor. Por lo mismo, deben esquivar una serie de obstáculos que van desde otros autos, peatones imprudentes que se cruzan sin previo aviso por lugares prohibidos o mascotas que se lanzan a la vía sin medir las consecuencias.

Así las cosas, dicho automóvil debe tener dentro de su programación todo un set de datos que, sea cual sea la situación, deben estar en la capacidad de actuar como la brújula moral, con el fin de ayudar a evitar a toda a costa atentar en contra de los derechos humanos, preservar el bienestar común, evitar abusos y demás normas éticas necesarias para poder considerar a dicho sistema como “confiable”.

Ahora bien, si hablamos de “buenas prácticas” a nivel de autos autónomos que son usados por el consumidor común, surge toda una serie de preguntas a nivel de usuarios más específicos y avanzados como es el caso de:

- ¿Qué tipo de ética deberían manejar los dispositivos militares con Inteligencia Artificial?

- ¿Hasta qué punto los ejércitos podrán usar la Inteligencia Artificial sólo con fines de exploración?

- ¿Será que deberíamos tener una brújula morar que impida el uso de armas autónomas?

- ¿Es posible gozar de los beneficios de una Inteligencia Artificial ética a nivel de la industria bélica del mundo?

Esas y otras preguntas aún están por resolverse pero, grandes compañías como Huawei, están trabajando de la mano con organizaciones como AI4People para que la Inteligencia Artificial tenga una aproximación ética donde el ser humano siempre debe ser lo más importante.

Pero… ¿qué principios podría ayudar a tener una Inteligencia Artificial con ética?

Existen 5 principios que pretenden establecer un acuerdo marco para moldear las buenas prácticas en las relaciones. Los sistemas con Inteligencia Artificial deben tenerlo como brújula moral en el proceso de integración, aprendizaje y despliegue en cualquier caso:

- La beneficencia: debe promover el bienestar, preservar la dignidad del ser humano y la sostenibilidad del planeta

- No servir fines maléficos: debe guardar la privacidad, seguridad y la capacidad de actuar con cautela

- Autonomía: debe establecer un balance entre el poder de tomar decisiones. Que el ser humano tiene que preservar y el que se puede llegar a delegar a la AI

- Justicia: debe crear beneficios compartidos y preservar la solidaridad

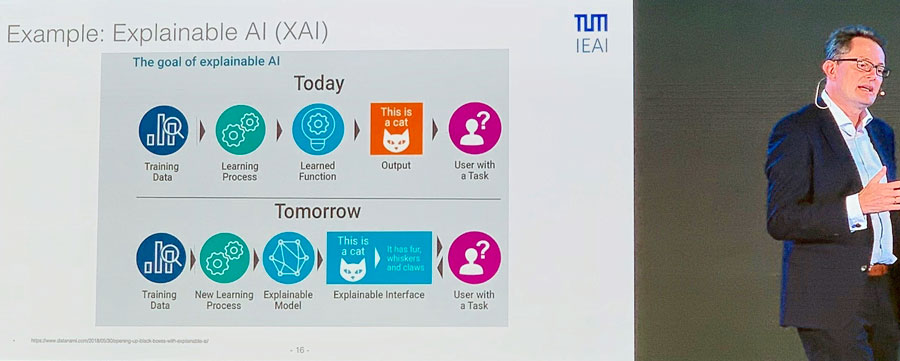

- Explicabilidad: debe preservar la inteligibilidad y confiabilidad

¿Cuál es la finalidad de meterle ética al diseño, integración y uso de la Inteligencia Artificial?

La finalidad es simple, se pretende establecer un marco de justicia y ética que pueda ser claro y unívoco (eliminando los sesgos propios del temperamento humano) para explicar las ventajas, riesgos, casos y el costo de oportunidad que va implícito en el uso de la Inteligencia Artificial en el día a día para, de esta forma, más adelante, cuando la tecnología se encuentre madura, ¡no tener que lamentarse!