Tal como lo decía anteriormente en otro artículo, Medios Sintéticos es un termino genérico creado recientemente que denota el contenido generado artificialmente por medio de una Inteligencia Artificial (AI). Lo sé, eso suena como a una definición sacada de una película pero, por aterrador que parezca, es una realidad a la cual tendremos que acostumbrarnos! El aprendizaje profundo permite a las máquinas analizar cantidades inmensas de data (textos, imágenes, video, música y demás) y con el entrenamiento adecuado, poder generar sus propias interpretaciones de la misma.

También lo veíamos en el artículo acerca de la Inteligencia Artificial Generativa, esta se puede tomar algunas licencias haciendo que, cada vez sea más difícil, no sólo diferenciar lo real de lo inventado sino entender cómo la IA llega a esos medios tan extraños, lo que puede ser un obstáculo para la adopción, aceptación y corrección de las salidas o resultados del proceso.

¿Qué es lo peligroso acerca de los Medios Sintéticos?

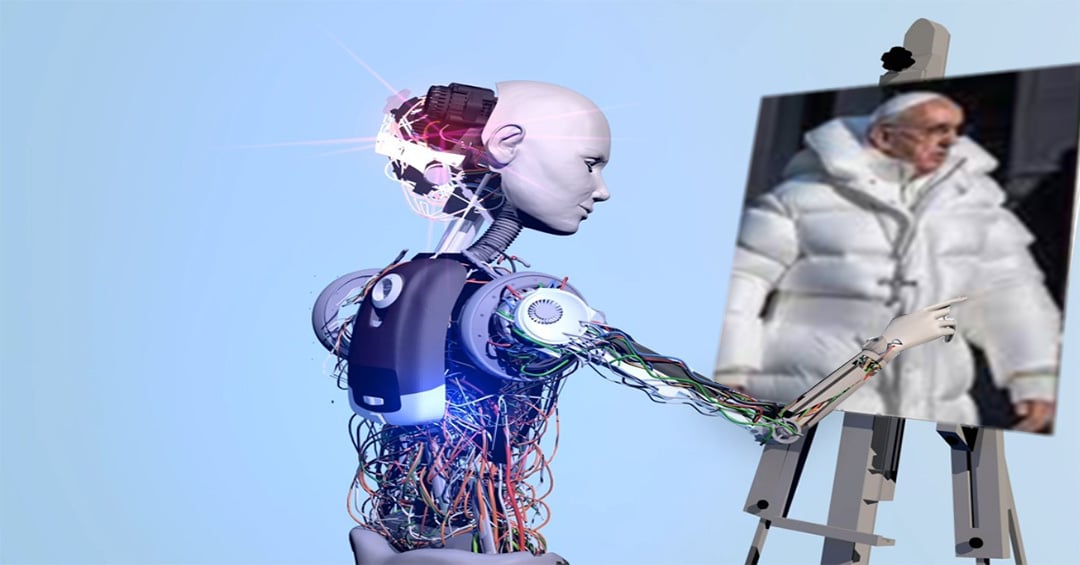

La percepción de lo real y lo que no lo es en relación a los contenidos que se ven en internet y, sobre todo en redes sociales, está cambiando de manera muy rápida, dado que en ocasiones resulta difícil discernir entre lo real y lo que se ha creado o ha sido manipulado de manera sintética. Cada vez es más difícil discernir dado que, los DeepFakes han llegado a un nivel de perfección que pueden llegar a engañar hasta a los más expertos.

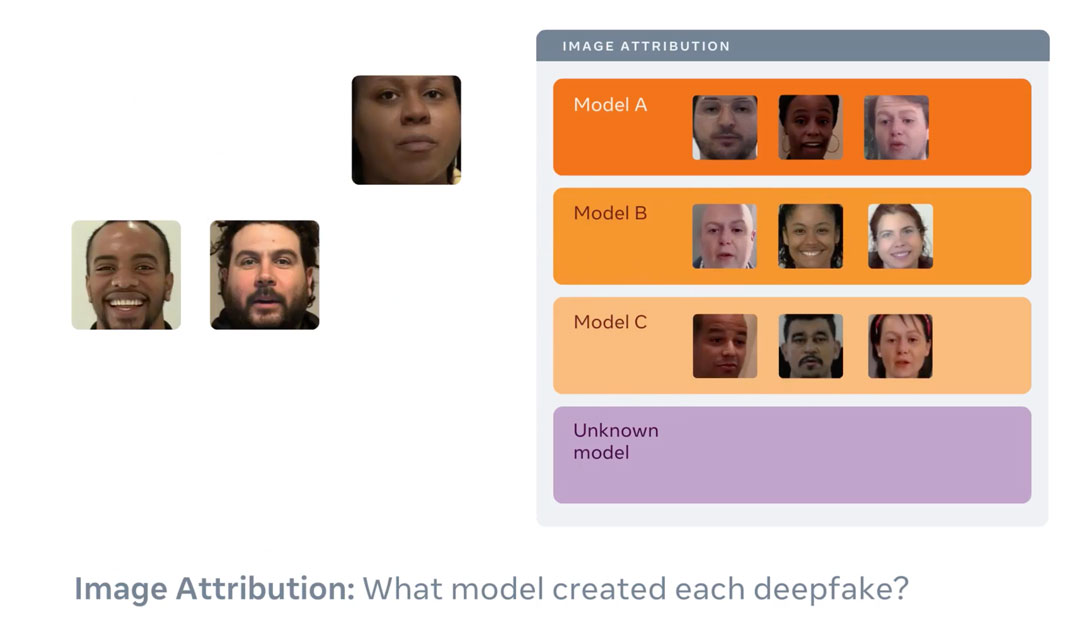

El riesgo está en que este tipo de tecnologías hace más barato, rápido y fácil manipular a las masa al crear Medios Sintéticos con un nivel de realidad que puede llegar a confundir al cerebro de cualquiera, tan increíbles son los resultados, que en ocasiones es necesario usar un método de análisis digno de un forense, con la ayuda de una red neuronal para poder determinar la veracidad de ciertos contenidos multimedia.

Los riesgos de la AI Generativa y los Medios Sintéticos?

Lastimosamente, tanto la AI generativa como los Medios Sintéticos pueden presentar riesgos similares dado que, ambos pueden ser utilizados para crear contenido falso o engañoso, como deepfakes o noticias falsas, con el fin de difundir información errónea, propaganda o incluso para influir en campañas electorales.

Así las cosas, “el futuro es sintético” y con todas estas magnificas posibilidades generadas por la llegada de los Medios Sintéticos, hay que empezar a pensar en nuevas formas para proteger la identidad y para valorar el tipo de contenido que consumimos y, peor aún, que compartimos a nuestros familiares, amigos y, sobre todo, a nuestros seguidores.

Si cualquier contenido puede ser creado sintéticamente, no se debe tragar entero todo lo que se ve en redes sociales, hay que validar múltiples fuentes de manera juiciosa la información (pensar en el qué, por qué, el contexto y para qué fue creada) antes de creer con fe ciega!

Y entonces… Qué hacer frente a estos riesgos?

Finalmente, para evitar situaciones complejas, existen 5 principios éticos que pretenden establecer un acuerdo marco para moldear las buenas prácticas en las relaciones con los sistemas con Inteligencia Artificial, algo como una especie de brújula moral en el proceso de integración, aprendizaje y despliegue. Esos principios son:

- La beneficencia: debe promover el bienestar, preservar la dignidad del ser humano y la sostenibilidad del planeta,

- No servir fines maléficos: debe guardar la privacidad, seguridad y la capacidad de actuar con cautela,

- Autonomía: debe establecer un balance entre el poder de tomar decisiones. Que el ser humano tiene que preservar y puede llegar a delegar a la IA,

- Justicia: debe crear beneficios compartidos y preservar la solidaridad,

- Confiabilidad: debe preservar la inteligibilidad y generar confianza.