Recientemente en una nueva publicación de blog, OpenAI ha presentado “Superalignment” (superalineación), la cual, tiene como objetivo crear métodos fuertes y escalables para alinear estos sistemas con los valores humanos en anticipación de la Superinteligencia (se supone que es una forma muy avanzada de IA). Sin embargo, hay que resaltar que dicho poder también conllevaría varios riesgos inherentes.

Los mejores datos acerca de Superalignment

Desde OpenAI piensan que la “superinteligencia” puede llegar a convertirse en una realidad dentro de esta década. Es por tal motivo que, recientemente han anunciado su trabajo con la “Superalineación” como un medio de gobernanza efectiva y realmente firme y asimismo, mecanismos de alineación.

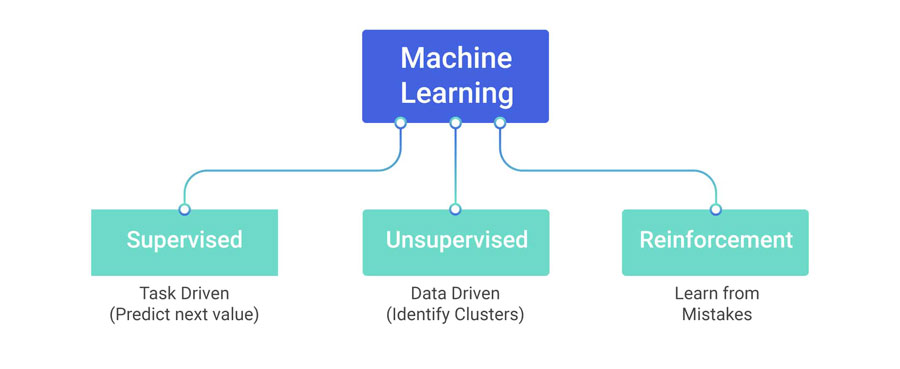

Es importante señalar que desde ya, las técnicas convencionales de alineación de Inteligencia Artificial (IA), como el aprendizaje por refuerzo a partir de la retroalimentación humana, se basan en la supervisión humana. Sin embargo, hay que dejar bastante claro que cuando se trata de sistemas de IA que superan la inteligencia humana, la capacidad de supervisión de los humanos se torna limitada.

Ahora bien, hay que acotar que debido a esto, la reconocida compañía “OpenAI” cree que las técnicas de alineación existentes no escalarán una vez que se logre la superinteligencia. Según se ha conocido, para poder resolver este problema que se aproxima, quieren desarrollar un investigador de alineación automatizado que se aproxime a las capacidades de nivel humano.

Según han informado, este investigador de alineación servirá como base para escalar los esfuerzos de alineación usando recursos computacionales sustanciales. Pero, hay que resaltar que para que esto sea una realidad, el equipo de Superalignment tiene como objetivo centrarse en tres aspectos clave:

- Métodos de capacitación escalables,

- Validación de modelos de alineación

- Pruebas de estrés de la canalización de alineación.

Pero, cabe hacerse una pregunta bastante importante: ¿qué sucede con las tareas que son demasiado desafiantes para que los humanos las evalúen apropiadamente? Por lo que hay que dejar claro que para poder resolver este problema, el equipo propone aprovechar los sistemas de Inteligencia Artificial (IA), para ayudar en el proceso de evaluación. Según se pudo conocer, este enfoque, conocido como “supervisión escalable”, puede lograr brindar una señal de capacitación sobre tareas difíciles. Incluso, cabe acotar que el equipo tiene como objetivo comprender y asimismo, controlar cómo los modelos generalizan la supervisión a tareas no supervisadas, abordando el tema crucial de la generalización.

Por lo tanto, a partir de ahí, OpenAI planea automatizar la búsqueda de comportamientos internos y problemáticos para poder optimizar la solidez y la interpretabilidad. Hay que resaltar que al identificar problemas potenciales, el equipo tiene como objetivo construir modelos de alineación que tengan la capacidad de poder alinear de manera confiable los sistemas de IA superinteligentes con los valores humanos. Sin duda, OpenAI es sumamente optimista y cree que un esfuerzo concentrado y concertado puede llevar a la alineación exitosa de los sistemas IA superinteligentes.

Algunos puntos de vista de otros acerca de Superalignment