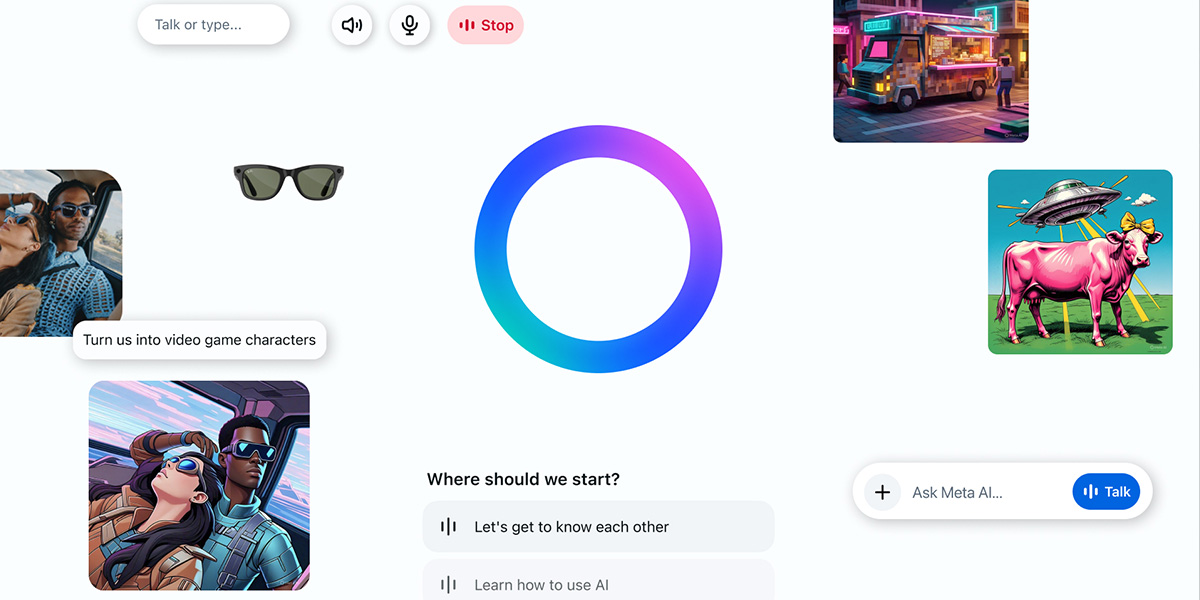

En la carrera por hacer que la inteligencia artificial sea más útil, personal y transparente, Meta acaba de dar un paso audaz, peligroso y bastante polémico: hacer públicas algunas de las búsquedas y conversaciones de sus usuarios con Meta AI. A través de una función llamada “Discover”, disponible en la app móvil, ahora cualquiera puede explorar conversaciones ajenas con la IA, como si se tratara de un feed social más.

Aunque la idea suena interesante desde una perspectiva de comunidad, intercambio de conocimiento e incluso entrenamiento de modelos, plantea un dilema ético profundo: ¿hasta qué punto los usuarios son conscientes de que sus preguntas (que pueden llegar a ser íntimas), búsquedas existenciales o dudas profesionales podrían quedar expuestas?

Lo bueno: transparencia y aprendizaje colectivo

Desde el lado positivo, esta función podría democratizar el aprendizaje basado en IA. Ver cómo otros formulan preguntas, resuelven problemas o exploran temas puede ser útil para mejorar la propia interacción con estos modelos. Además, abre la puerta a un nuevo tipo de red social cognitiva donde el conocimiento se comparte de forma directa, sin filtros.

Para los desarrolladores que de la IA, también puede ser una oportunidad invaluable para observar cómo se comportan los usuarios reales en escenarios no controlados. Esto alimenta mejoras futuras, desde la personalización hasta la detección de sesgos o errores.

Lo preocupante: privacidad borrosa y consentimiento confuso

Sin embargo, la otra cara de la moneda es mucho más sombría. Según algunos expertos, la mayoría de los usuarios no saben que sus interacciones pueden ser visibles para otros. Algunos han compartido temas delicados: desde conflictos de pareja hasta dilemas sobre religión o salud mental. Esta falta de claridad puede llevar a situaciones de vulnerabilidad innecesarias.

Meta afirma que estas publicaciones están marcadas como públicas, pero el diseño de la interfaz y la forma de compartir contenido no parecen dejarlo suficientemente claro para todos. Y eso nos lleva a una pregunta esencial: ¿es ético permitir la publicación automática de contenido generado en una conversación privada con una IA sin explicar claramente las implicaciones?

Precedentes riesgosos

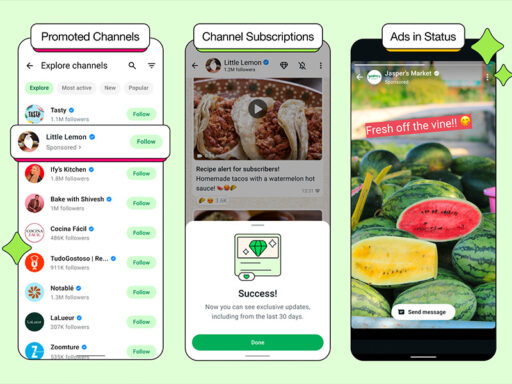

No nos digamos mentiras, Meta no ha sido precisamente un bastión de la privacidad (se acuerda del escándalo de Cambridge Analytica, o de lo que pasó cuando cambiaron los términos y condiciones de Whatsapp for business, de la tenue línea que separa la seguridad vs la privacidad?…) y con este movimiento, la compañía establece otro precedente que podría influir en otras plataformas. Si normalizamos la publicación de conversaciones privadas, aunque sean con un chatbot, ¿dónde trazamos la línea? ¿Qué garantiza que la información sensible no se utilice para entrenar modelos comerciales o para segmentación publicitaria?

Y… ¿Entonces que pensar de Meta AI?

La función “Discover” de Meta AI representa una nueva frontera en la interacción con chatbots. Pero como ocurre con muchas tecnologías emergentes, el entusiasmo no puede eclipsar la ética. Si se quiere impulsar el conocimiento colectivo sin poner en riesgo la privacidad individual, es necesario rediseñar las reglas del consentimiento digital, con transparencia real, opciones claras y respeto por la intención del usuario.