Durante años, la inteligencia artificial fue presentada como una herramienta que ayudaba: respondía preguntas, redactaba textos o sugería ideas. Pero en 2026 esa definición empieza a quedarse corta. Ahora Google está empujando una nueva etapa donde la IA ya no solo asiste, sino que directamente ejecuta tareas. Y ese cambio, aunque suene sutil, transforma por completo la forma en que trabajamos.

Modelos como Gemini fueron el primer paso visible. Permitieron que cualquier persona interactuara con sistemas capaces de entender lenguaje, generar contenido y resolver problemas. Sin embargo, había una limitación clara: todo terminaba en una respuesta. La IA podía decirte qué hacer, pero no lo hacía por ti.

Lo que está emergiendo ahora es diferente. La idea de los “agentes” introduce sistemas que no solo entienden una instrucción, sino que pueden llevarla a cabo. Es decir, pasan de ser asistentes a convertirse en una especie de “trabajadores digitales”. Pueden investigar, organizar información, tomar decisiones simples y ejecutar procesos dentro de una empresa.

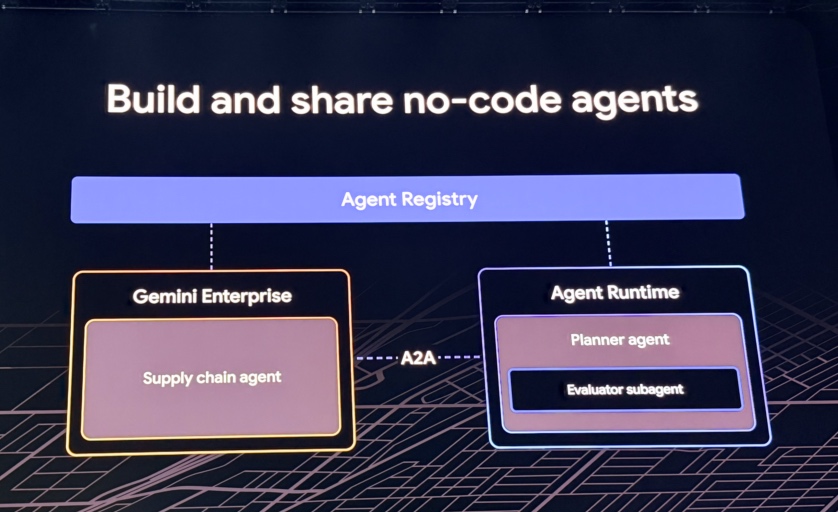

Para lograr esto, Google ha construido una especie de “plataforma invisible” que permite crear estos agentes de manera más sencilla. Antes, desarrollar algo así implicaba integrar múltiples sistemas, escribir mucho código y lidiar con conexiones complejas. Hoy, gran parte de ese esfuerzo se reduce. Los agentes pueden conectarse con herramientas, acceder a información y aprender de su uso sin que todo tenga que construirse desde cero cada vez.

Uno de los cambios más importantes es que estos sistemas empiezan a tener algo parecido a memoria. No en el sentido humano, pero sí en la capacidad de recordar interacciones pasadas, aprender de ellas y mejorar con el tiempo. Esto rompe con una de las grandes limitaciones de la IA tradicional, que era empezar desde cero en cada interacción.

También cambia la forma en que se controla la tecnología. Cuando un sistema empieza a tomar acciones, ya no basta con que funcione bien; necesita reglas claras. Google está incorporando mecanismos para definir qué puede hacer un agente y qué no, estableciendo límites similares a los que tendría un empleado dentro de una organización. Esto incluye desde restringir acceso a cierta información hasta evitar que ejecute acciones sensibles sin supervisión.

Otro aspecto interesante es que estos agentes no están pensados para trabajar solos. Pueden comunicarse entre sí, dividir tareas y colaborar. Es como pasar de tener una herramienta individual a tener un pequeño equipo digital coordinado. Esto abre la puerta a automatizaciones mucho más complejas, donde distintos agentes se encargan de diferentes partes de un proceso.

Para quienes desarrollan tecnología, también aparece una capa nueva de apoyo. Herramientas como Gemini Cloud Assist ayudan a detectar errores, entender qué está fallando y proponer soluciones. Es una especie de asistente que ayuda a construir otros asistentes, lo que acelera aún más el ritmo de desarrollo.

Pero más allá de la tecnología, lo que realmente está cambiando es el rol de las personas. Antes, el trabajo consistía en ejecutar tareas paso a paso. Ahora, empieza a moverse hacia definir objetivos, supervisar resultados y validar decisiones tomadas por sistemas automáticos. Es un cambio silencioso, pero profundo: de hacer directamente el trabajo a dirigir cómo se hace.

La inteligencia artificial está dejando de ser una herramienta puntual para convertirse en una capa operativa dentro de las organizaciones. Ya no se trata solo de usar IA, sino de trabajo conjunto de agentes humanos y no humanos.

El concepto esta cambiando a paso agigantados: durante años, el desarrollo de software consistió en decirle a la máquina exactamente qué hacer. Con los agentes, ese modelo cambia. Ahora definimos objetivos, reglas y límites… y el sistema decide cómo ejecutarlos.

Eso tiene ventajas evidentes: velocidad, escalabilidad, automatización real. Pero también introduce una nueva responsabilidad. Ya no se trata solo de escribir código correcto, sino de diseñar sistemas que se comporten correctamente.

Google lo resume en un concepto interesante: “desplazar la seguridad hacia abajo”. Es decir, que la infraestructura sea la que garantice las reglas, liberando al desarrollador de gestionar cada detalle.