Conforme las personas intentan encontrar más usos para la IA generativa que tengan menos que ver con hacer una foto falsa y más bien sean realmente útiles, Google planea dirigir la Inteligencia Artificial a la ciberseguridad y hacer que los informes de amenazas sean más fáciles de leer. En una publicación de blog, Google ha escrito que su nuevo producto de ciberseguridad, “Google Threat Intelligence”, combinará el trabajo de su unidad de ciberseguridad Mandiant y la inteligencia de amenazas VirusTotal con el modelo Gemini AI. ¡Todos los detalles al respecto a continuación!

Datos más destacados que tiene que conocer acerca del nuevo producto de ciberseguridad

Es crucial dar a conocer que, el nuevo producto usa el modelo de lenguaje grande Gemini 1.5 Pro, que según Google disminuye el tiempo necesario para aplicar ingeniería inversa a los ataques de malware. La compañía ha afirmado que Gemini 1.5 Pro, lanzado en el mes de febrero, tardó tan solo 34 segundos en analizar el código del virus WannaCry (el ataque de ransomware de 2017 que paralizó a hospitales, empresas y otras organizaciones en todo el mundo) e identificar un interruptor de apagado. Es de resaltar que, eso es impresionante, pero no sorprendente, dada la habilidad de los LLM para leer y escribir código.

Pero otro posible uso de Gemini en el espacio de amenazas es resumir los informes de amenazas en lenguaje natural dentro de “Threat Intelligence” para que las empresas tengan la capacidad de poder evaluar cómo los ataques potenciales pueden afectarlas o, en otras palabras, para que las empresas no reaccionen de forma exagerada o insuficiente ante las amenazas.

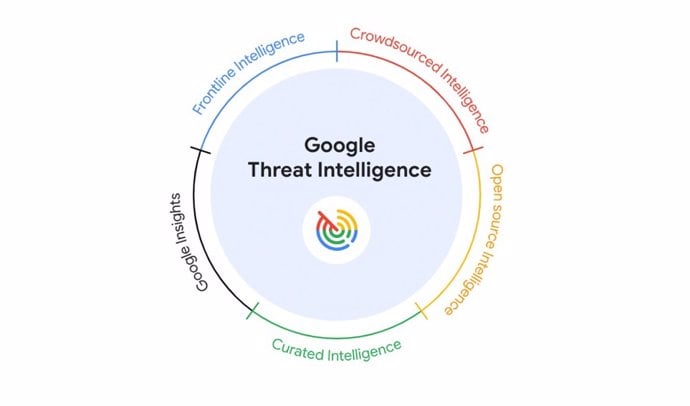

Google ha señalado que “Threat Intelligence” también tiene una vasta red de información para monitorear amenazas potenciales antes de que ocurra un ataque. Según se informa, permite a los usuarios ver una imagen más amplia del panorama de la ciberseguridad y priorizar en qué centrarse. Mandiant suministra expertos humanos que monitorean grupos potencialmente maliciosos y consultores que trabajan con empresas para bloquear ataques. La comunidad de VirusTotal por su parte, también publica periódicamente indicadores de amenazas.

Según se ha podido descubrir, la compañía también planea usar los expertos de Mandiant para evaluar las vulnerabilidades de seguridad en torno a los proyectos de Inteligencia Artificial (IA). A través del “Secure AI Framework” de Google, Mandiant probará las defensas de los modelos de IA y ayudará en los esfuerzos de formación de equipos rojos. Aunque los modelos de Inteligencia Artificial pueden ayudar a resumir las amenazas y aplicar ingeniería inversa a los ataques de malware, los propios modelos ocasionalmente pueden convertirse en presa de actores maliciosos. Estas amenazas a veces incluyen “intoxicación de datos”, que añade código incorrecto a los datos que recopilan para que los modelos no puedan responder a indicaciones específicas. Por lo mismo, es bueno utilizar que la IA para aspectos mucho más allá de una imagen.