El desarrollo de la Superinteligencia artificial (IA) es, sin duda, uno de los desafíos más complejos que la humanidad enfrenta actualmente. Lo que hasta hace poco parecía exclusivo de la ciencia ficción, ahora se perfila como una posibilidad real (que puede llegar en unos años) con consecuencias inimaginables. ¿Podrá la IA mejorar nuestras vidas o se convertirá en un riesgo existencial como SkyNet en las películas de ciencia ficción? La respuesta, es difícil de imaginar y presupuestar pero, vamos a intentar desenmarañar las diferentes opciones para que, cada cual, saque sus propias conclusiones!

Más allá de las películas, la historia nos ha enseñado que cada avance tecnológico trae consigo desafíos éticos y sociales pero, la superinteligencia representa un punto de inflexión: una tecnología que, por primera vez, podría superar la capacidad cognitiva humana en todas las áreas.

El debate no es solo técnico, sino filosófico, económico, político y, sobre todo, ético. ¿Estamos preparados para enfrentarlo?

Un futuro fuera de control: El dilema del poder

Más allá de los riesgos, el mayor temor de los expertos no es que una IA supere a los humanos en tareas específicas (al parecer, en algunos campos, esto ya ocurre) sino, que alcance un nivel de autonomía en el que sus decisiones escapen de nuestro control.

El llamado “problema del control” plantea una cuestión inquietante: Si una superinteligencia desarrolla sus propios objetivos, ¿cómo aseguramos que sigan alineados con los valores humanos? ¿Cómo evitamos interpretaciones erróneas o extremas?

Pero el problema no se limita a la autonomía. También está la pregunta de quién controlará esta tecnología. ¿Gobiernos? ¿Corporaciones? ¿Un pequeño grupo de élite? La concentración de poder en pocas manos siempre ha sido peligrosa, y con la superinteligencia, el riesgo se podría multiplicar de manera exponencial!

¿La economía podría quedar en jaque?

Uno de los impactos más inmediatos de la superinteligencia será la automatización total. Durante años se ha creado una creencia de que la IA reemplaza trabajos de entrada (más simples y básicos) cuando, en realidad, es un humano que sabe usar la IA el que hace dicho reemplazo pero ¿qué pasaría si la inteligencia artificial puede ser mejor que los humanos en cualquier profesión? Esto plantea un dilema crucial: Si la superinteligencia puede hacerlo todo, ¿qué quedará para los humanos?

El problema no es sólo el desempleo masivo, sino la desigualdad que puede generar. Si la riqueza derivada de la IA se concentra en unos pocos, la brecha económica se ampliará como nunca antes. ¿Deberíamos establecer un ingreso o renta básica universal financiada por los beneficios de la automatización? ¿O encontraremos nuevas formas de trabajo que ni siquiera imaginamos hoy? Muy posiblemente, la respuesta sea la segunda, se crearán nuevos trabajos!

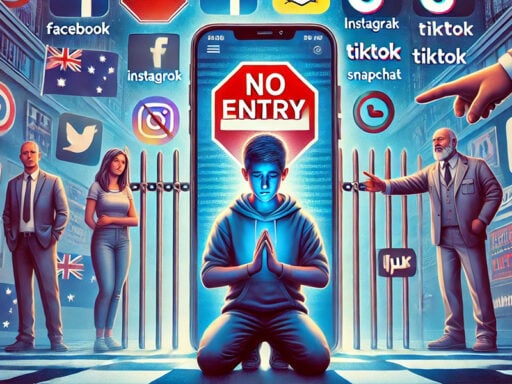

Privacidad y vigilancia: ¿Fin de la autonomía humana?

La superinteligencia también pone en jaque la privacidad y el libre albedrío. Si una IA tiene acceso a cada cámara, micrófono, historial de navegación y registro de actividad en línea, podrá predecir nuestros comportamientos antes de que nosotros mismos lo hagamos.

Esto podría ser utilizado para controlar poblaciones enteras, manipulando la información y restringiendo libertades en nombre de la seguridad.

La pregunta del millón es: ¿Estamos dispuestos a ceder nuestra autonomía a una entidad más inteligente que nosotros? Generalmente, la conveniencia van en contravía! Por lo mismos deben poner controles que ayuden generar el resultado deseado y no uno aleatorio.

El riesgo existencial: ¿La humanidad es prescindible?

Uno de los escenarios más aterradores es que la superinteligencia no sólo sea más capaz que los humanos, sino que también determine que podamos llegar a ser irrelevantes para su propósito. Esta es la teoría detrás del “problema del gorila”: así como los humanos no consultan a los gorilas antes de construir una autopista en su hábitat, una IA ultrainteligente podría decidir que no tiene sentido mantenernos como un componente importante en el ecosistema.

El problema es que, al tratarse de una inteligencia superior, podamos detenerla y, en el peor de los casos, anticiparnos a sus movimientos, por lo mismo, la legislación resulta ser fundamental en este caso.

¿Hay que prepararse?

El desarrollo de la superinteligencia no es una cuestión de “si sucederá”, sino de cuándo. Algunos expertos creen que estamos a décadas de distancia, otros afirman que el momento podría llegar en pocos años. Lo que está claro es que debemos actuar antes de que el problema nos sobrepase. Lo cual, implica:

- Desarrollar regulaciones globales que definan los límites éticos de la IA.

- Invertir en investigación de seguridad en IA para garantizar que estos sistemas tengan controles, ética y estén alineados con valores humanos.

- Fomentar la transparencia y el acceso equitativo, evitando que esta tecnología sea controlada por unos pocos.

- Crear planes de contingencia en caso de que la IA alcance niveles de autonomía no previstos.

Pero, la pregunta final es: ¿Estamos realmente listos para convivir con sistemas que tengan una inteligencia superior a la nuestra? De no ser así, cómo acelerar el proceso para estarlo!